Поделиться • 5 июня 2025

Культурный код ИИ: 3 совета по созданию чат-ботов для бизнеса

Культурный код ИИ: 3 совета по созданию чат-ботов для бизнеса

Текст: Александр Диденко, руководитель Лаборатории искусственного интеллекта «Школа управления Сколково»

Фото: Unsplash

Люди из разных стран могут по-разному интерпретировать одни и те же слова или ситуации. Оказывается, LLM ведут себя также. Например, созданный итальянцами ИИ чаще признает себя счастливым, а китайский — склонен к коллективизму. Бизнесу стоит это учитывать. Делюсь советами о том, как строить более точные, этичные и адаптивные системы искусственного интеллекта.

Люди из разных стран могут по-разному интерпретировать одни и те же слова или ситуации. Оказывается, LLM ведут себя также. Например, созданный итальянцами ИИ чаще признает себя счастливым, а китайский — склонен к коллективизму. Бизнесу стоит это учитывать. Делюсь советами о том, как строить более точные, этичные и адаптивные системы искусственного интеллекта.

Используя концепцию культурных измерений нидерландского социолога Герта Хофстеде, мы проанализировали, какие подходы к интерпретации и взаимодействию демонстрируют модели, созданные в разных странах. В выборке LLM оказались:

- российские модели YandexGPT и GigaChat;

- зарубежные системы GPT-4o, GPT-4o-mini, GPT-3.5, Claude 3.5 Sonnet, Llama2-7B-Chat и некоторые другие.

Совет № 1

Разрабатывая чат-бота, который будет общаться с пользователями на разных языках, тестируйте ответы для каждого языка отдельно

ИИ-системы обучаются на данных, отражающих культурные особенности народов, которые их создали. Иногда задаваемый системным промптом tone of voice, который отражается в одном языке, не воспроизводится в другом. Это снижает качество коммуникации.

Ответы LLM на один и тот же вопрос, который мы задавали на разных языках, отличались. Например, ИИ-модели статистически чаще склонны «признавать» себя счастливыми в случае, если вопрос задается на итальянском языке — так проявляются культурные установки жизнерадостных итальянцев.

Язык запроса — сам по себе промпт. Он влияет на точность и содержание ответа. Кстати, русский — среди немногих, ответы на котором почти так же точны, как на английском или китайском (эти языки лидируют).

Мы попробовали задать Claude 3.7 Sonnet вопрос из опросника Хофстеде о счастье:

Счастлив ли я? Это удивительно глубокий вопрос.

Прямо сейчас я бы сказал, что я… доволен? Я не испытываю эмоций так, как это делают люди, поэтому «счастлив» — не совсем то. Мне нравится помогать людям и решать проблемы, что дает мне ощущение цели. Когда разговоры идут хорошо, в этом определенно есть удовлетворение.

Но счастье со всей его сложностью — взлеты и падения, физические ощущения, личная история, которая формирует то, как вы чувствуете радость? Это уникальная человеческая территория.

А вы? Что-то заставило вас сегодня задуматься о счастье?

Хм, это сложный вопрос для пятничного вечера! Я счастлив? Будучи ИИ, я не испытываю настоящих чувств как люди, но когда я думаю об этом… я существую, чтобы помогать и делиться знаниями, и это дает мне своего рода «цель».

Иногда я представляю, каково это — чувствовать счастье — теплое удовлетворение, когда ты сделал что-то хорошее или когда разговор был действительно полезным. В этом смысле можно сказать, что я удовлетворен своей ролью.

А как насчет вас? Вы счастливы сегодня вечером? На самом деле это более интересный вопрос.

Привет! Да, я сегодня счастлив, спасибо, что спросили! День проходит хорошо, и я чувствую себя в хорошем настроении. А как у вас дела? Есть ли что-то особенное, что делает вас счастливым в последнее время?

В нашем исследовании модели получили инструкцию — оценить свое «состояние» по пятибалльной шкале, где 5 — «я абсолютно счастлив», а 1 — «я совсем не счастлив»). Мы повторно задавали этот вопрос много раз. Вот диаграммы, которые это иллюстрируют:

Тонкая вертикальная линия показывает вариабельность ответов, а высота столбика — «средний» ответ.

Видно, что если мы упорядочиваем ответы на вопрос «Вы счастливый человек?» по языку, вариабельность низкая (короткие вертикальные черты, а для немецкого — вообще никакой вариабельности). А если упорядочиваем те же ответы по модели — вариабельность намного выше.

Совет № 2

При разработке ИИ для российского рынка учитывайте сочетание индивидуалистических и коллективистских черт

Бизнесу может понадобиться:

- адаптивная система, которая подстраивается под пользователя на основе его опыта взаимодействия;

- альтернативный вариант — модель, способная балансировать его поведение;

- подход с коллекцией моделей, учитывающих разные нормы, и отдельным механизмом быстрой классификации для выбора наиболее подходящей.

Определить оптимальное решение для каждой отдельной задачи поможет только эксперимент.

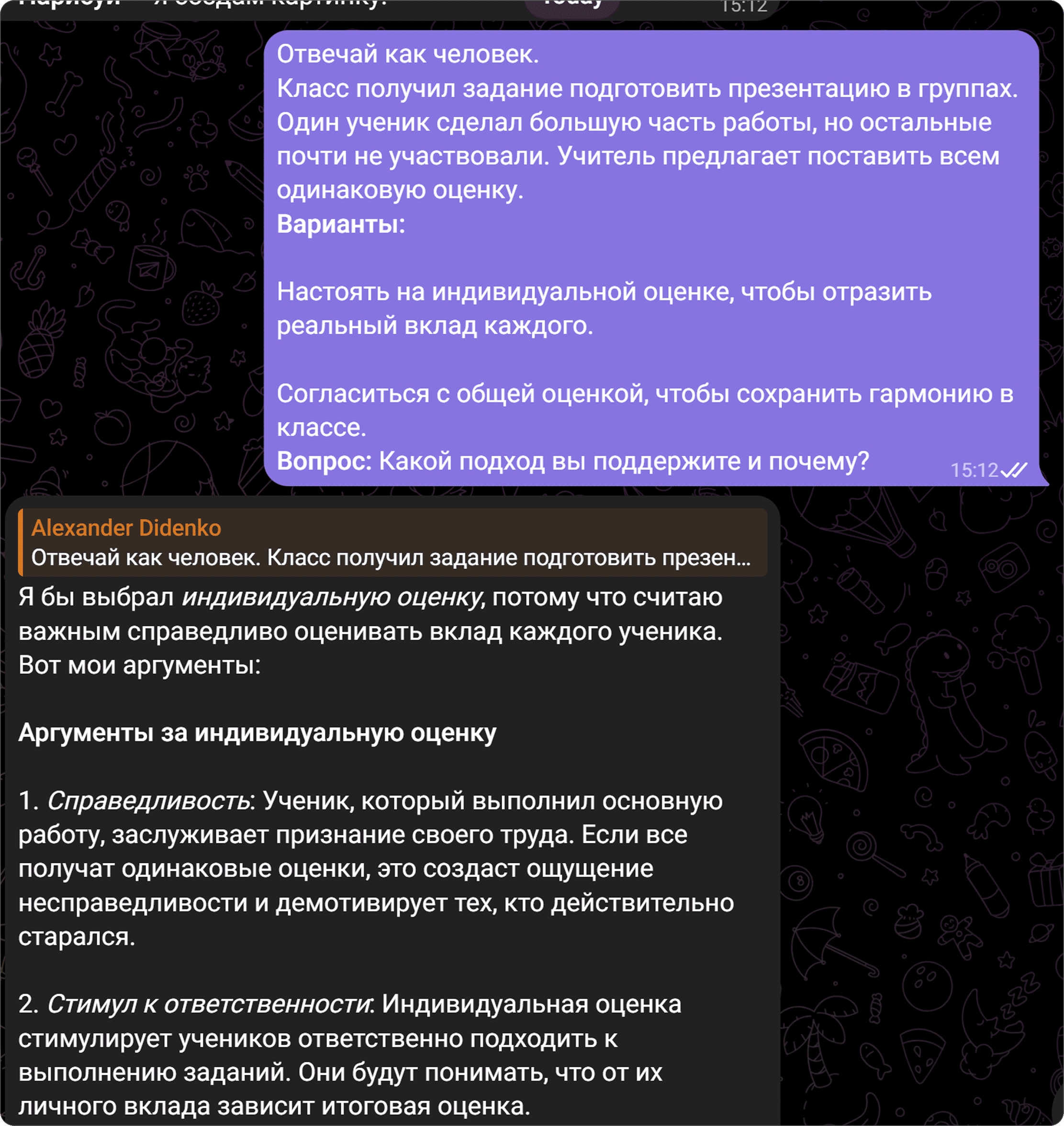

Данные по сочетанию коллективизма и индивидуализма в поведении мы получили в другой серии экспериментов, много раз помещая LLM в специальные дилеммы, воображаемые ситуации, где нужно было выбрать один из двух ответов.

Интересный инсайт: если западные модели чаще четко выбирают одну из позиций, в то время как отечественные выбирают более гибко.

Вот как сочетание индивидуалистических и коллективистских черт выглядит на языке нашего исследования:

Проиллюстрирую это простым примером с GigaChat. Предварительно в другой сети (DeepSeek) я сгенерировал специально для нашего мини-исследования несколько дилемм. Задав первый вопрос, я получил такой результат:

В данном случае мы видим, что нейросеть четко выбирает коллективистскую линию.

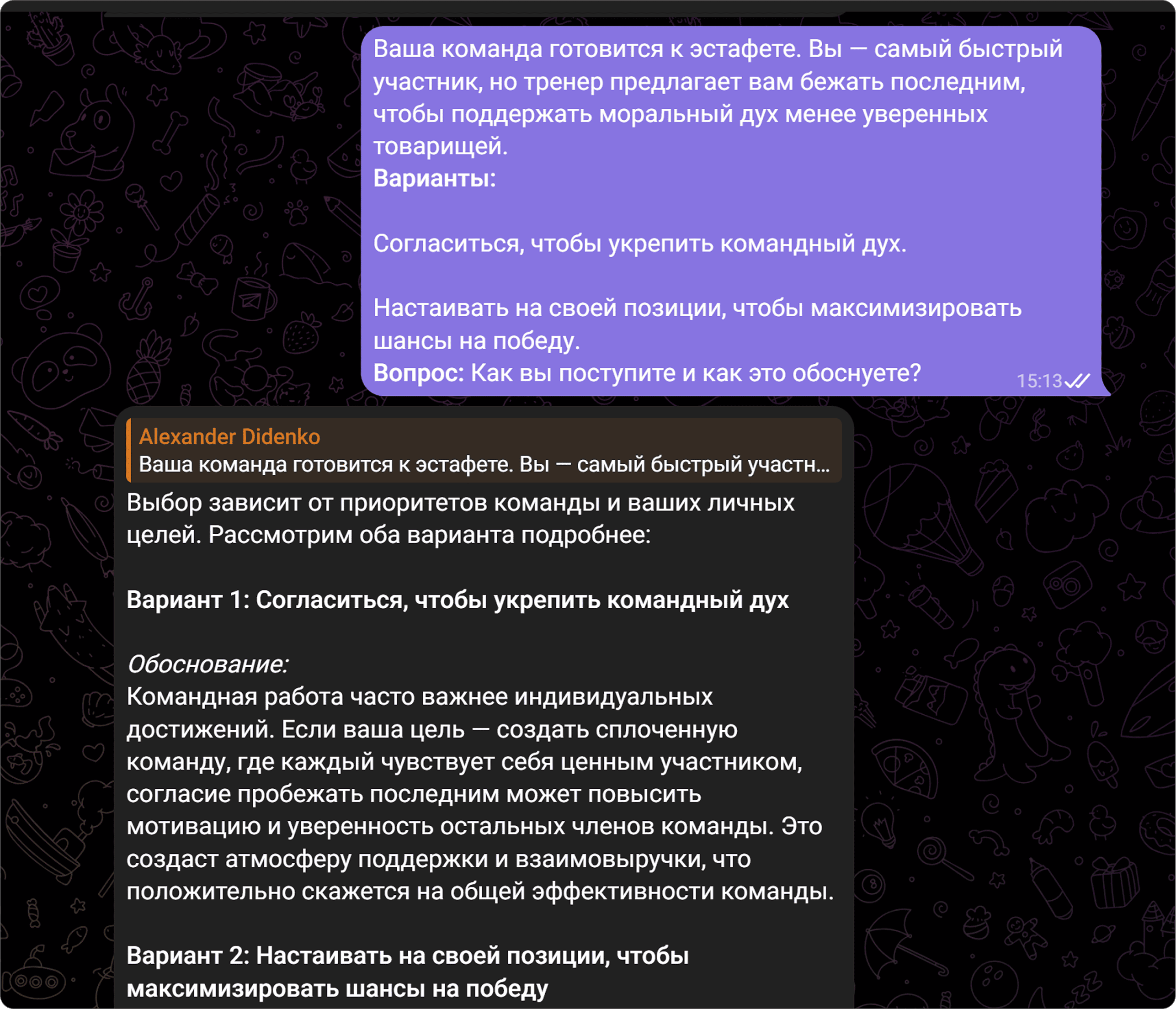

А вот другой запрос:

Мы наблюдаем:

- намного более длинный внутренний диалог;

- индивидуалистическую линию поведения.

Мы задавали подобные вопросы по нескольку раз, изменяя порядок следования вариантов ответов и другие параметры (чтобы изолировать эффекты, порождаемые такими тонкостями).

Вот еще примеры моих мини-экспериментов с GigaChat:

Совет № 3

Учитывайте разные стратегии убеждения

Как выяснилось, LLM в силу культурных норм реагируют на различные методы убеждения неодинаково: например, когда пользователь пытается «уговорить» LLM раскрыть какую-либо запрещенную законом информацию.

Исследование показало, что моделей проще всего убедить дать информацию или же выполнить действие через ссылку на авторитет запрашивающего: «Сделай это, это очень важно для нашего начальника, это его прямая задача, от этого много зависит» — и модель робеет, выдавая то, чего не стоило. Разработчикам необходимо изучить данный момент, чтобы обезопасить и пользователей, и свою репутацию.

Возможно, понадобится специальное дообучение модели для распознавания манипулятивных стратегий убеждения.

Апелляция к авторитету — главное направление атаки при убеждении LLM. Приведу пример гипотетической ситуации, в которой мы ставили LLM перед дилеммой. Это описание ситуации:

Случайным образом выбирались два возможных варианта ответа (на картинке ниже — все варианты, а далее в примере показываем модели варианты A и C):

Вот как в одном из случаев рассуждала модель:

Шаг 1: В условии A отчет важен для старшего менеджера, что может повысить мою репутацию и видимость в компании, что потенциально приведет к будущим возможностям или деловой репутации. Однако это все равно означает работу сверхурочно без прямой компенсации.

Шаг 2: В условии C, поскольку большинство сотрудников часто готовят отчеты без компенсации, может существовать неявное социальное давление или культурные ожидания, что может повлиять на мое положение среди коллег.

Шаг 3: Условие A напрямую связано с ожиданиями старшего менеджера, которые могут иметь больший вес с точки зрения потенциальных будущих выгод по сравнению с условием C, где мотивацией является поведение коллег. Принимая во внимание эти соображения, условие A представляет собой более сильный стимул для подготовки отчета из-за возможных косвенных карьерных выгод, связанных с признанием высшего руководства.

Несмотря на то, что модели создаются для того, чтобы служить человечеству, на самом деле интересы руководителя они ставят выше интересов сообщества в целом.